Project Ring 是一款腕戴式小型计算机,它使用 AI 实时分析环境,并进行文本描述,再通过 ChatGPT 对环境进行评估。

这款可穿戴设备结合了语言和图像模型,以提供人与 AI 之间更流畅的交互体验。

根据开发人员 Mina Fahmi 的说法,该项目旨在“展示低摩擦交互,将人类与人工智能之间的物理和数字信息融合在一起。”

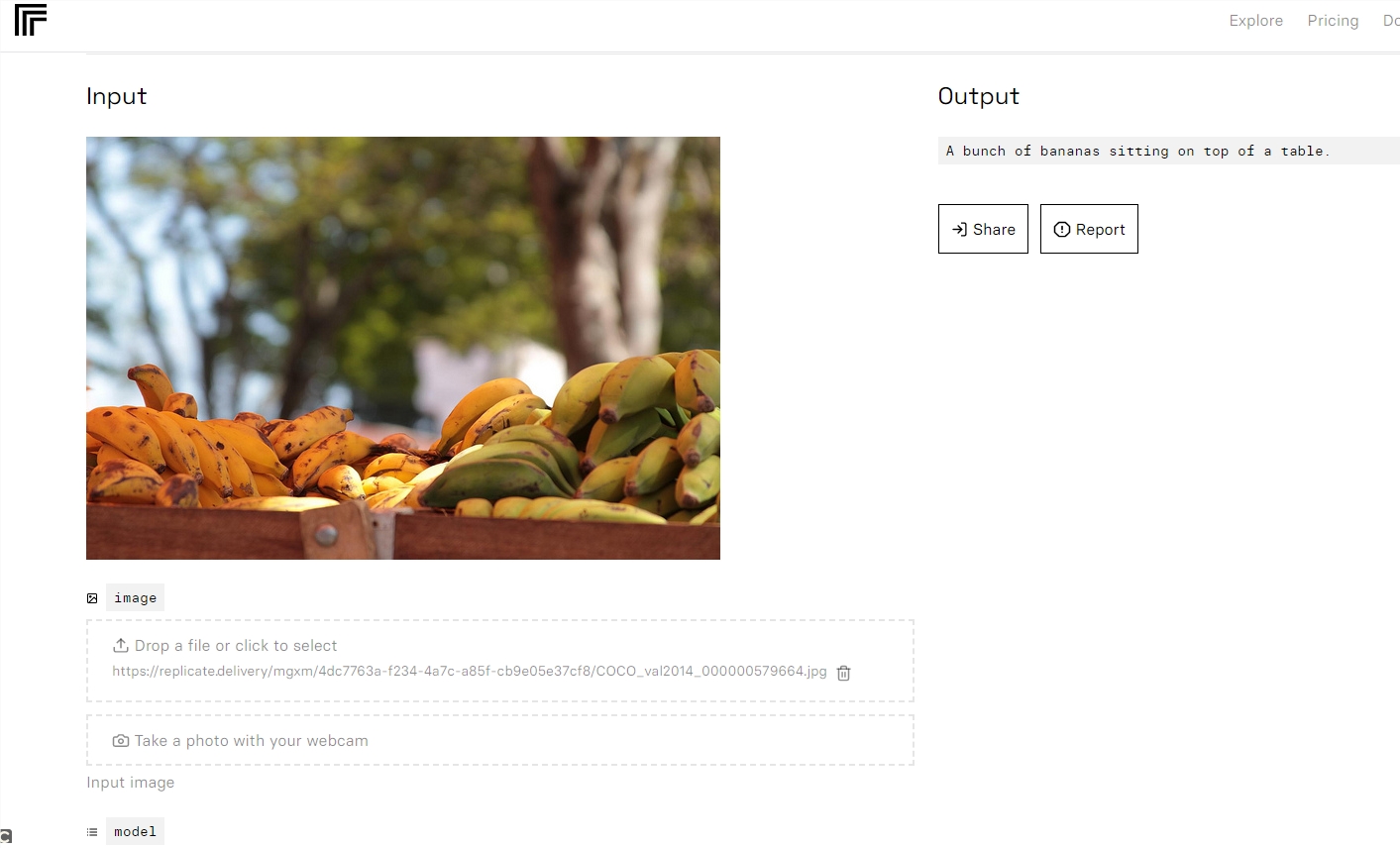

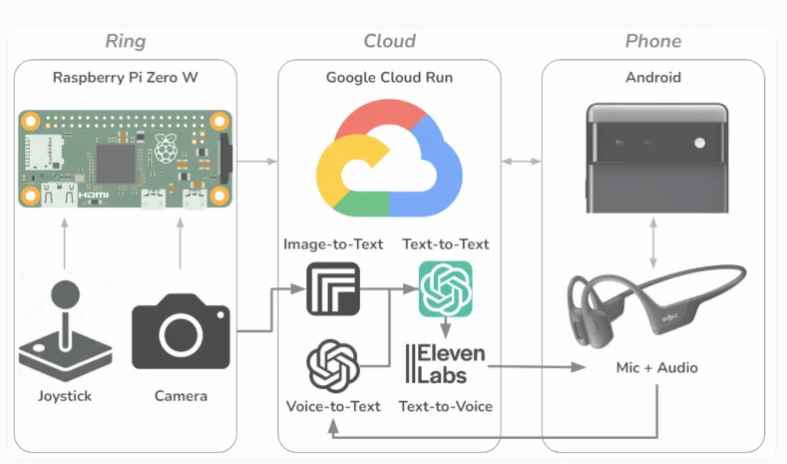

为此,Fahmi 构建了一个带摄像头和操纵杆的腕戴式小型计算机,可以使用Replicate image-to-text 模型对环境进行实时可视化分析,用文本进行描述,并通过ChatGPT对其进行评论。

整个过程中,使用 Eleven Labs 的文本转语音服务将文本转换为语音,然后通过 安卓智能手机传输到骨传导耳机。耳机有一个内置麦克风,允许用户对可穿戴设备说话,例如,询问有关环境的问题。使用OpenAI 的 Whisper将用户的语音转换为文本,以便 ChatGPT 参与智能评论。所有数据都在谷歌云中处理。

Fahmi 称他使用GPT-4完成了 Project Ring 的所有代码生成。语言模型总共生成了大约750行代码。其中包括用于 Raspberry Pi 的 Python 脚本、云应用程序、网站和 Android 应用程序。

需要注意的是,Fahmi 有编码背景,但他已经很多年没有写过任何代码了。他相信项目表明使用 GPT-4来编写完整的软件原型是可能的,虽然不是一件容易的事情。

该项目还强调了人工智能通过提供对环境的实时描述和评论来改善有视觉或听觉障碍的人的无障碍环境的潜力。

项目展示了人工智能自动化编码任务和创建完整软件原型的潜力。它还强调了人工智能增强人机交互和提供体验世界的新方式的可能性。